Kun je iets vertellen over je rol als Senior Data/BI Consultant? Wat houdt je werk precies in?

Mijn rol bestaat uit het bespreken van vereisten met stakeholders en de Product Owner (PO) en uit technische inzichten/details verschaffen over de dataproducten waar ik aan heb gewerkt. Daarnaast geef ik functioneel en technisch advies over de dataproducten waar ik bekend mee ben, implementeer ik holistische dataoplossingen (van ruwe data tot datavisualisatie) op basis prioriteiten.

Je hebt veel ervaring in je vakgebied. Wat vind je het meest uitdagend en ook het meest bevredigend in je werk?

Bij het starten van een nieuw project is de grootste uitdaging om grip te krijgen op de sector van de klant, de bedrijfsprocessen te begrijpen en de belangrijkste aandachtspunten te identificeren. Het meest bevredigende aspect is om te zien dat mijn werk bruikbare en inzichtelijke resultaten oplevert voor de klant.

Welke technologieën en tools gebruik je het liefst en waarom?

Ik heb gewerkt met bekende tools (bijv. Visual Studio, SQL Server Management Studio, etc.) en andere niche tools (bijv. Jitterbit, Data Virtuality, etc.). Persoonlijk heb ik geen voorkeur voor specifieke platforms of tools, omdat de meeste leveranciers vergelijkbare functionaliteiten bieden om dagelijkse datataken uit te voeren.

Kun je een voorbeeld geven van een project waar je echt trots op bent en wat je bijdrage was aan dat project?

Ik heb een dataproject, CMF bij een pensioenuitvoeringsorganisatie, overgenomen (90% voltooid) en wist de klant te overtuigen om functies te schrappen die theoretisch nuttig leken, maar in de praktijk nooit werden gebruikt. Hierdoor werd de verwerkingstijd van de batchjob teruggebracht van 2-3 dagen naar ongeveer 20 uur. Daarnaast heb ik de nauwkeurigheid van het premieberekeningsmodel aanzienlijk verbeterd (van een variatie van 1,5% naar slechts 0,001%).

Hoe blijf je op de hoogte van de nieuwste ontwikkelingen in de wereld van data engineering en business intelligence?

Ik volg tech news, zowel professioneel als informee,l via techwebsites en sociale media. Daarnaast delen we kennis onder collega’s bij RBI Solutions.

Je komt oorspronkelijk uit China. Hoe heeft jouw achtergrond en internationale ervaring je werk beïnvloed?

Ik woon sinds eind 2001 in Nederland en heb hier al mijn hogere opleidingen gevolgd (bachelor & master). Ik heb nooit buiten Nederland gewerkt, maar wel voor een werkgever met een multinationale setting. Wat ik kan zeggen, is dat verschillende culturen verschillende kernwaarden kunnen hebben. Ik probeer altijd mijn best te doen om die verschillen te minimaliseren en de focus te leggen op de gemeenschappelijke basis om gewenste resultaten te behalen.

Hoe zou je de bedrijfscultuur bij ons omschrijven en wat maakt het voor jou aantrekkelijk om voor ons te werken?

Bij RBI is er weinig hiërarchie, geen bureaucratie, en het bedrijf heeft een jonge en energieke sfeer.

Als je een tip zou mogen geven aan toekomstige collega’s die bij ons willen werken, wat zou dat dan zijn?

Open-mindness.

Hoe zie je de rol van data engineering en business intelligence evolueren in de komende jaren? Wat moeten bedrijven volgens jou doen om voorop te blijven lopen?

Door de jaren heen zijn termen rondom data flink geëvolueerd: van reporting naar business intelligence, naar big data analytics en AI. Maar empirisch gezien draait het nog steeds grotendeels om reporting. Bedrijven moeten focussen op tastbare aspecten van hun kernactiviteiten en vermijden om op elke hype in te springen. De focus moet liggen op de basis: het bouwen van een toekomstbestendige datafundering.

Wat voor impact denk je dat jouw werk heeft op de beslissingen van onze klanten? Kun je een voorbeeld geven van hoe jouw werk het verschil heeft gemaakt?

Het dataproduct, waarvoor ik de afgelopen vier jaar verantwoordelijk ben geweest, is gebouwd om de proceskwaliteit van facturatie te borgen. Je kunt er mee aantonen dat alle facturen echt correct zijn. Sindsdien wordt het gebruikt als validatiemethode voor het evalueren van de resultaten van het facturatieproces. Tegenwoordig worden facturen pas goedgekeurd nadat de resultaten zijn gevalideerd.

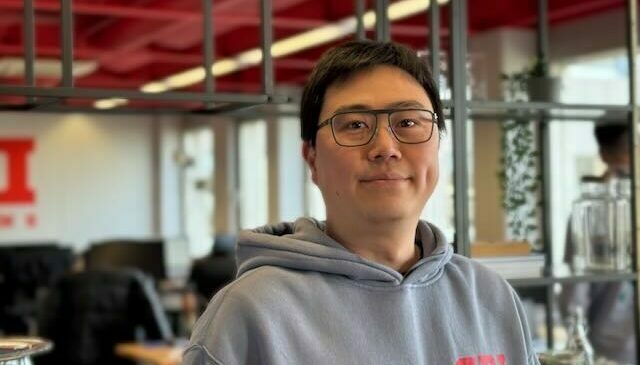

Bedankt Wensi, voor dit interview!