Femke, kun je ons meenemen in je carrièrepad?

“Absoluut! Na mijn studie Information Science aan de Vrije Universiteit begon ik mijn carrière bij RBI-Solutions. Door de jaren heen heb ik aan diverse uitdagende projecten gewerkt voor organisaties zoals Greenpeace, Odido en NS. Momenteel ben ik werkzaam als data engineer bij Holland Casino, waar ik me richt op het ontwikkelen van dataproducten die inzicht bieden in het online casino-platform.”

Wat maakt je rol bij Holland Casino uniek?

“Het is een boeiende uitdaging. Ik ben verantwoordelijk voor het datamodel en de dataproducten die de basis vormen voor de rapportages en dashboards. Het oorspronkelijke model was gebouwd door een andere partij, maar voldeed niet meer aan de wens van Holland Casino om zelf, binnenshuis, de controle te hebben. Mijn rol is om het model continu te verbeteren, zodat het aansluit bij de snel veranderende behoeften van Holland Casino.”

Kun je meer vertellen over de analyses die je maakt?

“We ontwikkelen dataproducten voor diverse gebieden, zoals analyses voor specifieke spelproducten, CRM, marketing, live casino, compliance en fraudedetectie. Het begon met standaardrapportages, maar nu richten we ons steeds meer op gespecialiseerde dashboards en datasets. Dit betekent dat we data uit zowel interne als externe systemen verwerken en integreren.”

Hoe ziet de samenwerking met je team eruit?

“Ik werk nauw samen met Product Owners en Power BI-specialisten. Zij zijn als het ware mijn klanten. Samen bepalen we welke data nodig is en hoe deze het beste gepresenteerd kan worden. Het is een heel dynamisch proces, vooral omdat we werken in een sterk gereguleerde omgeving.”

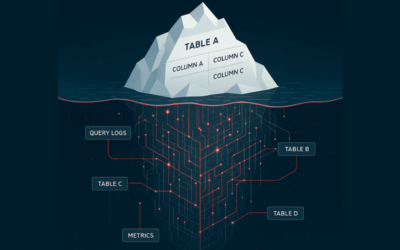

Wat is de grootste uitdaging in je werk?

“De continue optimalisatie van het datamodel. We moeten kritisch blijven kijken naar de bestaande structuren en deze verbeteren. Soms kom je keuzes tegen die in het verleden logisch waren, maar nu niet meer passen. Het is aan mij om die knelpunten aan te pakken.”

Wat vind je het leukste aan je werk?

“De combinatie van technische uitdagingen en bedrijfsinzicht. Elke verbetering in ons datamodel heeft directe impact op hoe de gebruikers naar hun online activiteiten kijken. Dankzij deze inzichten kunnen zij betere beslissingen nemen. Het is ontzettend waardevol om op die manier bij te dragen in een online omgeving.”

Welk advies geef je aan startende data engineers?

“Blijf nieuwsgierig en flexibel. De wereld van data ontwikkelt zich razendsnel. Durf bestaande modellen te verbeteren en werk constant aan je vaardigheden in datamodellering.”Tot slot, wat zie je als de toekomst van data engineering?

“Steeds meer bedrijven realiseren zich hoe cruciaal een goede data-infrastructuur is. Het draait niet alleen om data verzamelen, maar om het slim omzetten in waardevolle inzichten. Dit stelt organisaties in staat om efficiënter en effectiever te werken. Data gedreven werken kan alleen als de data goed georganiseerd, snel beschikbaar en gebruiksklaar is. Dat is waar wij elke dag aan werken.”